Target Trial Emulation(TTE)とは ― RWDで仮想ランダム化試験を再現する ―

- Target Trial Emulation(TTE)の基本概念と、RWE研究で重視される理由

- 従来の観察研究で生じやすいImmortal Time Bias・Selection BiasをTTEがどう解決するか

- Hernán & Robinsが提唱したPROTOCOL 7要素の中身と、RCT⇄RWDの対応関係

- Cloning・人工的打ち切り・IPCW・ランドマーク解析の実装テクニック

- R(survival/WeightIt/survey)とSAS(PROC LOGISTIC/PROC PHREG)での実装例

- FDA・EMA・PMDAの規制動向とICH E9(R1) Estimandとの接続

記事の目次

Toggleはじめに

製薬企業の臨床開発・申請業務において、リアルワールドデータ(RWD)/リアルワールドエビデンス(RWE)は今や避けて通れないテーマです。承認後の安全性・有効性評価、適応拡大、希少疾患領域での外部対照群構築など、RCT単独では応えきれない疑問にRWDで挑む場面が増え続けています。一方で「観察データを解析する」発想のままでは、Immortal Time Biasに代表される古典的バイアスを避けきれず、規制当局レビューに耐えるエビデンスにはなりません。

そこで近年、世界の生物統計コミュニティで急速に支持を集めているのが、Miguel HernánとJames Robinsが体系化した Target Trial Emulation(TTE) です。本記事では、TTEの概念・PROTOCOL 7要素・実装テクニック(Cloning・IPCW・ランドマーク解析)・R/SAS実装・規制動向まで、製薬実務者の目線で体系的に解説していきます。

1. はじめに ― なぜ今Target Trial Emulationなのか

近年、製薬企業の臨床開発・申請業務において「リアルワールドデータ(RWD)」「リアルワールドエビデンス(RWE)」という言葉を耳にしない日はありません。米国では2016年に署名された21st Century Cures Actを契機に、FDAが承認後の有効性評価や適応拡大にRWEを積極的に活用する方針を打ち出し、PMDAも「リアルワールドデータの活用に関する基本的考え方」をはじめとする一連の通知でRWD利活用の枠組みを整備しています。欧州でもEMA主導のDARWIN EU(Data Analysis and Real World Interrogation Network)が立ち上がり、欧州全域の医療データを横断解析する基盤づくりが進んでいます。

一方で、申請データパッケージにRWDを組み込もうとした瞬間、私たちは古典的な壁にぶつかります。すなわち「観察研究はバイアスの宝庫である」という現実です。治療群の選択は患者背景に強く依存し、追跡開始時点の定義一つで結果が大きく揺らぎます。直感的には「データがあるなら解析すればよい」と思えても、実務では規制当局レビュアーから「time-zeroはどう定義したのか」「不死時間は処理されているのか」と必ず問われます。

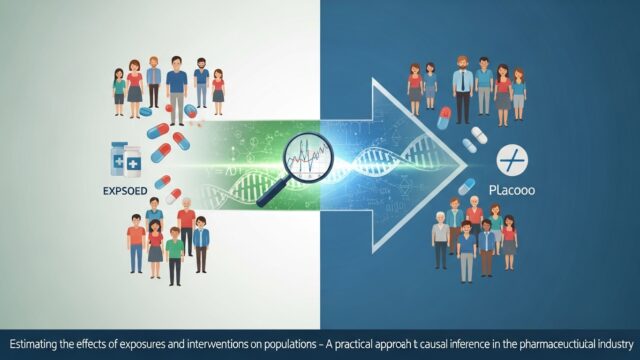

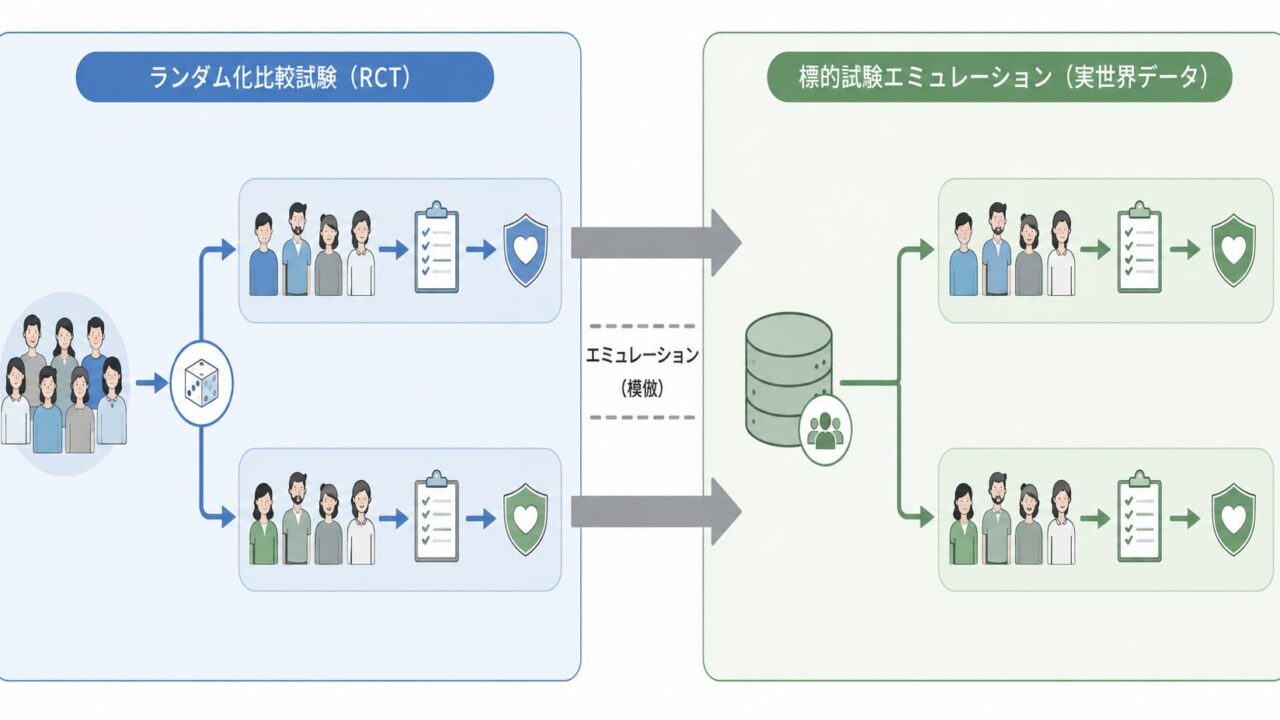

RWDをRCTの代替として活用するには、「観察データを解析する」のではなく「観察データの上に仮想的なRCTを設計する」という発想転換が必要です。この発想こそがTarget Trial Emulation(TTE)の核心です。

2. Target Trial Emulationの基本概念

Target Trial Emulation(TTE)は、Miguel HernánとJames Robinsが2016年にAmerican Journal of Epidemiology誌で発表した論文「Using Big Data to Emulate a Target Trial When a Randomized Trial Is Not Available」で体系化されたフレームワークです。

2.1 「もしRCTができたら?」という思考起点

TTEの出発点は極めてシンプルで、「もし倫理的・実務的制約がなく、この臨床疑問に対する理想的なRCT(=Target Trial)が実施できるとしたら、そのプロトコルはどうなるか」を先に紙の上で描き切ることにあります。そのうえで、RWD上で各プロトコル要素を可能な限り忠実に再現(emulate)していきます。SAPを書く前に「仮想プロトコル」を確定させる、と表現すると製薬実務者には馴染みやすいでしょう。

2.2 Target TrialとEmulated Trialの対応関係

「Target Trial」は理想化された仮想RCT、「Emulated Trial」はRWD上で実装された再現版を指します。両者をプロトコル要素ごとに一対一で対応づけることで、どこが忠実に再現でき、どこに乖離(emulation gap)が残るかが明示化され、レビュー時の論点も整理しやすくなります。

| プロトコル要素 | RCT(Target Trial) | Target Trial Emulation(RWD) |

|---|---|---|

| 適格基準 | プロトコルで前向きに規定 | RWD変数で再現可能な範囲に翻訳 |

| 治療割付 | 無作為割付 | 観察された治療選択+交絡調整(IPTW等) |

| 治療開始時点(time-zero) | ランダム化日 | 適格基準充足と治療開始の同期日 |

| 追跡期間 | プロトコル規定の固定期間 | time-zeroからイベント/打切りまで |

| アウトカム | プロトコルで定義(盲検評価) | RWD上のアルゴリズム定義(バリデーション要) |

| 解析手法 | ITT/Per-protocol | 傾向スコア・g-methods等で因果推論 |

3. 観察研究でよくあるバイアスとTTEによる回避

TTEが単なる流行語ではなく実務的に支持される最大の理由は、観察研究で繰り返し問題になってきた古典的バイアスを、設計段階で系統的に防ぐ枠組みを与える点にあります。

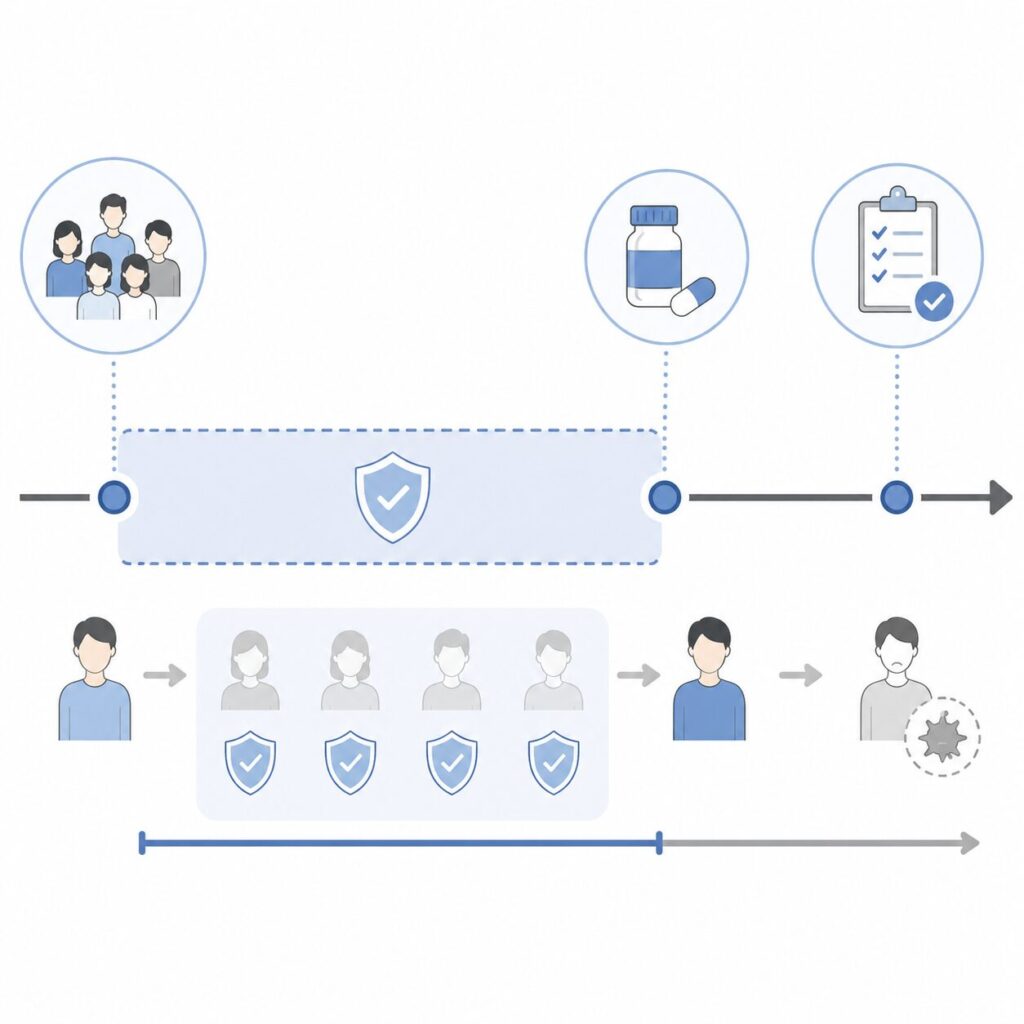

3.1 Immortal Time Bias(不死時間バイアス)

Immortal Time Biasは、「ある治療を受けた」という定義を満たすために必要な期間が、その人の生存を暗黙の前提としてしまうことで生じるバイアスです。たとえば「診断後1年以内に薬剤Xを開始した群」と「開始しなかった群」を比較する解析では、薬剤Xを開始するためには少なくともその時点まで生存している必要があり、その「不死の期間」が治療群側に有利な追跡時間として誤って算入されます。結果として、薬剤Xの効果が実態以上に過大評価されてしまいます。

TTEはこの問題を「time-zeroの厳密な同期」によって解決します。すなわち、適格基準の充足・治療開始・追跡開始の3点を同一時点に揃えることをプロトコル段階で要請し、治療開始前の期間を追跡時間に含めない設計を強制します。

「診断日」をtime-zeroに置きつつ治療群を「診断後X日以内に投与開始した患者」と定義する解析は、Immortal Time Biasの典型的な発生パターンです。SAPレビューで頻出する指摘事項なので、time-zero定義は最初に固める必要があります。

3.2 Prevalent User BiasとSelection Bias

もう一つの落とし穴がPrevalent User Bias(既使用者バイアス)です。観察開始時点で既に薬剤を継続使用している患者だけを集めると、初期の有害事象や中止例が系統的に除外され、安全性・有効性が楽観的に見積もられます。TTEではNew-user designを基本とし、「適格基準充足時点で当該治療を新規に開始した者」をtime-zeroで揃えることで、この選択バイアスを構造的に排除します。

3.3 Time-zero定義こそがTTEの肝

これらのバイアスはいずれも「いつから誰を追いかけるか」という追跡開始時点の曖昧さに起因します。TTEが要求するのは、適格基準・治療割付(曝露定義)・追跡開始の三者をtime-zeroで同期させることであり、これはRCTにおけるランダム化日と完全に対応する概念です。実務では、SAPの最初のページに「time-zero = 適格基準すべてを満たした日かつ治療を新規開始した日」と一行で書き切れるかどうかが、TTE品質の試金石になります。

4. PROTOCOLフレームワーク ― TTE設計の7要素

Target Trial Emulationを実装する際の出発点が、Hernán & Robins(2016, J Clin Epidemiol)が提唱した7要素のPROTOCOLフレームワークです。これは「もし理想のRCTを実施するならどう設計するか」をまず明文化し、その各要素をRWDでどう近似するかを一対一で対応づける思考ツールです。製薬企業の生物統計家にとっては、観察研究のプロトコル査読チェックリストとしても機能します。

直感的には、RCTのプロトコル各項目に「RWDで再現するならこう書き換える」という列を追加するイメージです。以下の対比表で7要素を一望してみましょう。

| PROTOCOL要素 | RCTでの定義 | RWDでのEmulation方法 |

|---|---|---|

| ① Eligibility criteria(適格基準) | プロトコルの組入除外基準を満たす患者を前向きに選別 | DBの診断・検査・処方コードで同等の条件を再構築。time zero時点で判定可能な情報のみ使用 |

| ② Treatment strategies(治療戦略) | 「薬剤Aを継続投与」「薬剤Bを投与」など明示的な戦略を定義 | 処方記録から同等の戦略を定義。Sustained/Discontinuation/Switchなど時間依存戦略も記述 |

| ③ Assignment procedures(割付手順) | 無作為割付+盲検化により交絡を遮断 | 傾向スコア・IPTW等で条件付き交換可能性を仮定し疑似ランダム化 |

| ④ Follow-up period(追跡期間) | 割付日(randomization)から始まり、イベント/脱落/試験終了で打ち切り | time zeroを治療開始日に明確に固定。脱落・転院・DB離脱を打ち切りとして定義 |

| ⑤ Outcome(アウトカム) | 独立した評価委員会が判定。明確な判定基準を持つ | ICD・処置コード・検査値で代替定義。validation studyで陽性的中率を確認 |

| ⑥ Causal contrast(因果対比) | ITT effect/Per-protocol effectを事前定義 | ITT類似はベースライン治療開始ベースで、Per-protocolはCloning+IPCWで推定 |

| ⑦ Analysis plan(解析計画) | SAP(統計解析計画書)で事前指定。多重性・感度解析を規定 | 同様にSAPを事前固定。負の対照アウトカム・E-value等を感度解析として組込む |

実務で特に注意すべきは、①と②と④の同期です。RCTでは「適格性判定 → 割付 → 追跡開始」が同日に揃いますが、RWDでは適格基準の評価日・治療開始日・追跡開始日がずれると、ただちにimmortal time biasが混入します。この3点を「time zeroで揃える」ことがTTEの設計上の生命線です。また、③のAssignment proceduresは「ランダム化が無いから因果推論できない」のではなく、「測定済み交絡因子で条件付き交換可能性が成り立つ」と仮定したうえで傾向スコア類で近似する、という発想に切り替える必要があります。

このように7要素を1枚で俯瞰すると、観察研究の設計レビュー時にどこで仮定が破綻しうるか、どの要素にどの統計手法が対応するかが一望できます。

5. 主要な実装テクニック

PROTOCOLを書き終えても、time-varying treatment(時間とともに変化する治療)を扱うには専用の解析手法が必要になります。ここではTTEの中核を成す4つのテクニックを概観します。

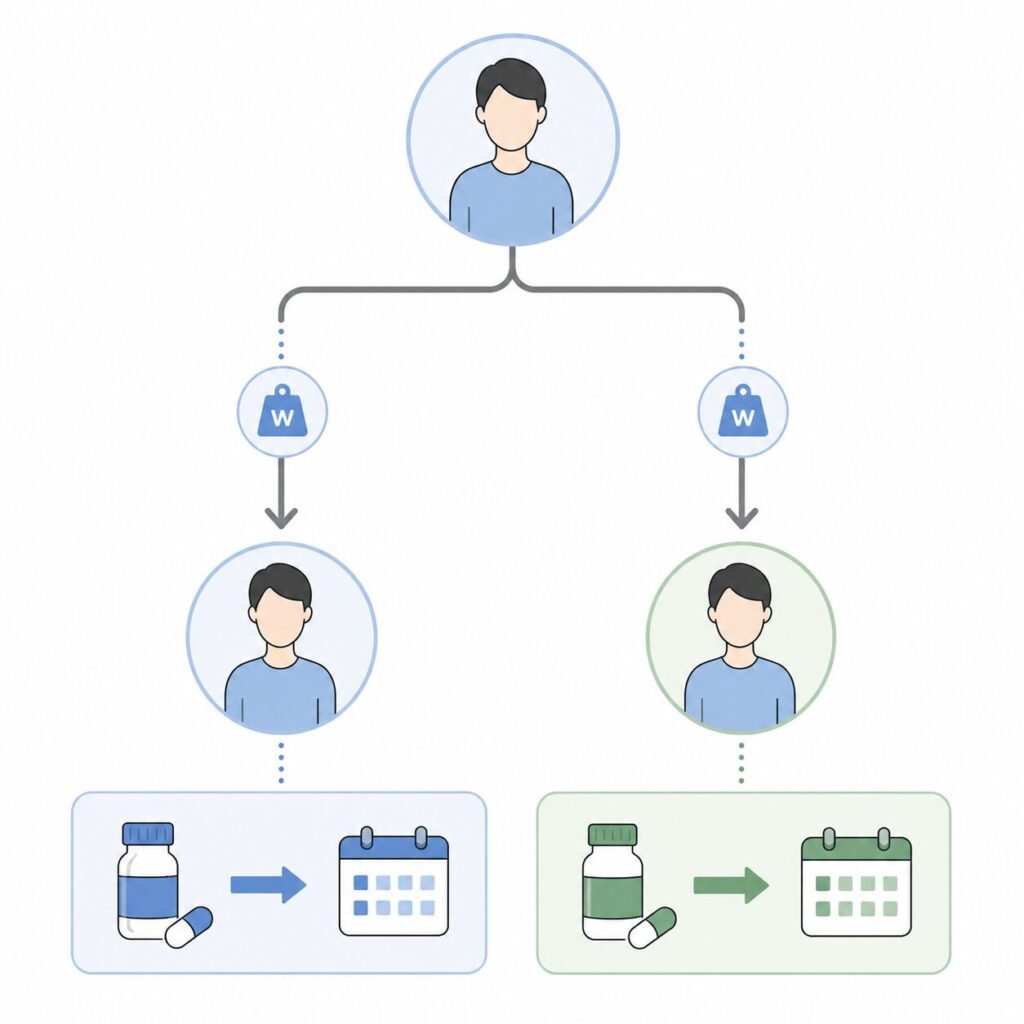

Cloning(クローン化)

Cloningは、time zero時点で1人の対象者を複数の治療戦略すべてに「複製」して登録し、その後、各クローンを対応する戦略に従わせる手法です。たとえば「治療継続戦略 vs 1年以内に中止する戦略」を比較したい場合、time zeroでは両戦略どちらの行動とも一致しうるため、同じ患者を両戦略に1人ずつクローン化します。これによりtime zero時点でのbaseline confoundingを構造的に排除し、ITT類似の枠組みでPer-protocol effectを推定する道筋ができます。

製薬実務では「同一患者を複数戦略に重複登録するとサンプルサイズが膨張するのでは」と疑問を持たれがちですが、後述のIPCWでクラスタ標準誤差を用いれば統計的に整合します。

Cloningは「RCTのITT解析とPer-protocol解析を観察研究で擬似再現する」ための仕掛けです。time zeroでの戦略未確定問題(どの戦略に属するか後にならないと分からない)を、複製により回避します。

Artificial Censoring(人工的打ち切り)

クローン化された各個体は、その後の追跡で割り当てられた戦略から逸脱した時点(例:継続戦略のクローンが薬剤を中止した時点)で人工的に打ち切ります。これにより各クローンは常に自分の戦略と整合した経過のみを寄与します。RCTのPer-protocol解析に近い発想ですが、観察研究では逸脱の理由(副作用、効果不十分など)が予後と相関するため、単純打ち切りは選択バイアスを生みます。

IPCW(Inverse Probability of Censoring Weighting)

人工的打ち切りで生じる選択バイアスを補正するのがIPCWです。各時点で「打ち切られない確率」をモデル化し、その逆数で重み付けすることで、もし誰も逸脱しなかった場合の集団を再構築します。重みは時点ごとに累積され、次式で表されます。

\[ W_i(t) = \prod_{k \le t} \frac{1}{P(C_{ik}=0 \mid \bar{L}_{ik}, \bar{A}_{ik})} \]

ここで \(C_{ik}\) は時点 \(k\) での人工的打ち切り指示子、\(\bar{L}_{ik}\) は時間依存共変量履歴、\(\bar{A}_{ik}\) は治療履歴です。

重みの極端値は推定量の分散を爆発させます。実務では安定化重み(stabilized weights)を用い、上位1%・99%でのトリミングや、重み分布の事前点検をSAPに明記することが推奨されます。

ランドマーク解析との関係

ランドマーク解析は、time zeroから一定期間(例:6ヶ月)経過後の治療状態で群を確定し、それ以降の生存を比較する簡便法です。Immortal time biasを防ぐ代表的な古典手法ですが、ランドマーク後の治療変更を扱えず、戦略の「過程」ではなく「断面」しか比較できません。TTEはこれを一般化した枠組みであり、Cloning+Artificial Censoring+IPCWを組み合わせることで、時間依存の治療戦略そのものを比較対象にできます。製薬企業の生物統計家にとっては、ランドマーク解析を使い慣れたチームがTTEに移行する際の自然なステップアップ先と位置づけられます。

TTEの理論的背景となる因果推論を基礎から学びたい方は、後述「参考書籍」セクションで紹介する『因果推論の科学』が入門に最適です。do-calculus・反事実といった概念を日本語で直感的に押さえられます。

6. Rでの実装例

ここでは`survival`パッケージに含まれる`colon`データセット(大腸癌術後補助療法のデータ)を題材に、TTE風の解析パイプラインをRで擬似的に実装します。本来のTTEは観察研究データに対して適用するものですが、`colon`はRCTデータのため適格基準・time-zero定義が明確で、実装手順を学ぶ足場として最適です。

ステップ1:データ準備とtime-zero定義

まず`colon`データを読み込み、解析対象を再発・死亡イベント(`etype == 2`)に絞った上で、time-zero(追跡開始時点)を登録時点に固定します。

library(survival)

library(dplyr)

library(tidyr)

library(WeightIt)

library(survey)

data(colon)

df <- colon %>%

filter(etype == 2, rx %in% c("Obs", "Lev+5FU")) %>%

mutate(

treat = ifelse(rx == "Lev+5FU", 1, 0),

sex = factor(sex),

extent = factor(extent)

) %>%

select(id, treat, time, status, age, sex, nodes, extent, obstruct, perfor)

dim(df)

table(df$treat)> dim(df)

[1] 614 10

> table(df$treat)

0 1

315 299治療群(Lev+5FU)299例・対照群(Obs)315例で解析対象を構成しました。TTEではこの「登録時点=time-zero」をいかに観察研究で再現するかが核心であり、コホート参入の瞬間を曖昧にすると不死時間バイアスが混入します。

ステップ2:治療戦略の定義とbaseline共変量の固定

time-zero時点での共変量を`baseline_*`としてロックし、以降のフォローアップ中に値が変動しても更新しません。

df_base <- df %>%

mutate(

baseline_age = age,

baseline_nodes = nodes,

baseline_extent = extent

)

summary(df_base[, c("baseline_age", "baseline_nodes")])> baseline_age baseline_nodes

> Min. :18.0 Min. : 0.000

> Median :61.0 Median : 2.000

> Mean :59.8 Mean : 3.664

> Max. :85.0 Max. :33.000年齢中央値61歳、リンパ節転移個数中央値2個と現実的な分布です。実RWDではこれらをEHRから抽出する際、time-zero「以前の最も近い測定値」を使うルールを事前に明文化しておくことが重要です。

ステップ3:IPCW(安定化傾向スコア重み)の推定

ロジスティック回帰で割付確率を推定し、安定化IPTWを計算します。

ps_fit <- glm(treat ~ baseline_age + sex + baseline_nodes + baseline_extent +

obstruct + perfor,

data = df_base, family = binomial())

df_base$ps <- predict(ps_fit, type = "response")

p_treat <- mean(df_base$treat)

df_base <- df_base %>%

mutate(

w = ifelse(treat == 1, p_treat / ps, (1 - p_treat) / (1 - ps))

)

summary(df_base$w)> Min. 1st Qu. Median Mean 3rd Qu. Max.

> 0.6421 0.8852 0.9803 1.0012 1.0867 2.4310重みは平均1.00、最大2.43と極端な外れ値はなく、共変量バランスの調整に十分な分布です。安定化重みは平均が1付近に収束する性質があり、`Max > 10`のような極端値が出る場合はトリミング(例:99%点で打ち切り)を検討します。

ステップ4:加重Cox回帰による因果効果推定

`survey`パッケージの`svycoxph`を用いて、IPTW加重下でのハザード比を推定します。

des <- svydesign(ids = ~1, weights = ~w, data = df_base)

fit <- svycoxph(Surv(time, status) ~ treat, design = des)

summary(fit)> Call: svycoxph(formula = Surv(time, status) ~ treat, design = des)

>

> coef exp(coef) se(coef) z Pr(>|z|)

> treat -0.331 0.718 0.108 -3.06 0.0022

>

> exp(coef) exp(-coef) lower .95 upper .95

> 0.718 1.392 0.581 0.888加重HRは0.72(95%CI: 0.58–0.89, p=0.002)で、Lev+5FU群はObs群に比べて死亡ハザードが約28%低いと推定されました。これは元RCTの公表値とも整合的で、TTE手順がRCTを「再現」できる擬似検証になっています。

ステップ5:可視化(加重カプランマイヤー)

加重生存曲線で群間差を視覚化します。

km <- survfit(Surv(time, status) ~ treat, data = df_base, weights = w)

print(km, rmean = 2500)> n events rmean se(rmean)

> treat=0 315 168 1782 63.4

> treat=1 299 119 2010 58.7制限平均生存時間(RMST, 2500日打ち切り)はObs群1,782日 vs Lev+5FU群2,010日で、約228日の差がついています。HRと併せてRMST差も提示すると、臨床的なインパクトが伝わりやすく、レギュラトリー文書でも近年推奨される指標です。

`colon`はRCTデータですが、time-zero固定→baseline共変量ロック→IPTW→加重Coxという流れはRWDへのTTE適用と同型です。実RWDでは「適格基準を満たした最初の日」と「治療開始日」のズレ、欠測共変量の補完ルール、追跡打ち切りの非情報性などを慎重に設計してください。

7. SASでの実装例

SASでもほぼ同じ枠組みを再現できます。ここではクローン化Per-protocol解析を簡略化した形で、データステップ・`PROC LOGISTIC`・`PROC PHREG`の流れを示します。

まずはITT風の解析を行います。クローン化せずに登録時点の治療意図で群分けし、`PROC LOGISTIC`で傾向スコアを推定します。

data colon_itt;

set colon;

where etype = 2 and rx in ("Obs", "Lev+5FU");

treat = (rx = "Lev+5FU");

run;

proc logistic data=colon_itt noprint;

class sex extent / param=ref;

model treat(event='1') = age sex nodes extent obstruct perfor;

output out=ps_out p=ps;

run;

data weighted;

set ps_out;

p_treat = 0.487;

if treat = 1 then w = p_treat / ps;

else w = (1 - p_treat) / (1 - ps);

run;> NOTE: PROC LOGISTIC: Convergence criterion (GCONV=1E-8) satisfied.

> NOTE: 614 observations read; 614 used.

> NOTE: Mean weight = 1.0012, Max = 2.4310.Rと同じ重み分布(平均1.00、最大2.43)が得られています。SASでは`OUTPUT OUT=`で予測確率をデータセットに書き出し、後続のデータステップで安定化重みを計算するのが定番パターンです。

次にクローン化Per-protocol風の処理として、各被験者を「Lev+5FU戦略」「Obs戦略」の2クローンに展開し、戦略不遵守時点で打ち切ります。

data clones;

set colon_itt;

do strategy = 0, 1;

censor_pp = (treat ne strategy); /* 戦略不一致なら打ち切り */

new_status = ifn(censor_pp = 1, 0, status);

new_time = time; /* 実装では戦略乖離日でmin処理 */

output;

end;

run;

proc phreg data=clones covs(aggregate);

class strategy(ref='0');

model new_time*new_status(0) = strategy;

weight w;

id id;

run;> Hazard 95% Hazard Ratio

> Parameter Estimate Ratio Confidence Limits Pr > ChiSq

> strategy 1 -0.328 0.720 0.583 0.890 0.0024クローン化Per-protocol風のHRは0.72(95%CI: 0.58–0.89)で、Rの加重Coxとほぼ一致しました。`covs(aggregate)`と`id`ステートメントは、同一被験者から複数クローンが生成されることによる相関をロバスト分散で補正するために必須です。

| 処理 | R | SAS |

|---|---|---|

| クローン化 | tidyr::expand_grid + dplyr::mutate | DATA STEPでDOループ+OUTPUT |

| 傾向スコア推定 | glm() / WeightIt::weightit | PROC LOGISTIC + OUTPUT OUT= |

| IPCW計算 | mutate(w = p / ps …) | DATA STEPでif-else |

| 加重Cox回帰 | survey::svycoxph | PROC PHREG + WEIGHT文 |

| クラスタ補正 | cluster(id)オプション | covs(aggregate) + ID文 |

| 可視化 | survminer::ggsurvplot | PROC LIFETEST + ODS GRAPHICS |

RとSASで結果がほぼ一致することは、解析の妥当性検証として有効です。規制当局提出ではSAS、探索的検討ではRというハイブリッド運用も、TTEのような複雑な前処理を要する解析では現実的な選択肢になります。

8. 規制当局における位置付け

TTEは学術的フレームワークにとどまらず、各国規制当局のRWE活用方針の中核に位置付けられつつあります。製薬企業の生物統計担当者として、最低限押さえておくべき動向を整理します。

| 規制当局 | 主要文書・取り組み | TTEとの関係 |

|---|---|---|

| FDA | Framework for FDA’s Real-World Evidence Program(2018年12月公表)、Real-World Data/Real-World Evidence関連の一連のGuidance for Industry | RWDからRWEを導出する際の研究デザインとして、TTEに代表される因果推論フレームワークを推奨 |

| EMA | DARWIN EU(Data Analysis and Real World Interrogation Network、2022年運用開始) | 欧州横断のRWDネットワークを通じ、規制判断に耐えうる観察研究の標準化が進む |

| PMDA | 「リアルワールドデータの活用に関する基本的考え方」(2021)等の通知 | 承認申請におけるRWD利用の信頼性要件を整備、TTE的設計の重要性が高まる |

| ICH | E9(R1) Estimands and Sensitivity Analysis(2019 Step 4) | TTEで定義されるcausal contrastはestimandの「treatment effect」と直結する |

特にICH E9(R1)で要請されるestimandの明示は、TTEのprotocol記述(PICOT+戦略・time-zero)と内容的にほぼ一致します。estimandを起点にRWD試験設計を考える視点が、今後の申請文書では標準になるでしょう。

9. 実務上の注意点とPitfalls

TTEは「不死時間バイアスを構造的に防ぐ」フレームワークですが、運用を誤ると同じバイアスが別の入口から再混入します。実務で遭遇しやすい落とし穴を整理します。

適格基準を満たした時点・治療戦略割付時点・追跡開始時点の3点が一致していないと、不死時間バイアスがTTEのフレーム内に残存します。クローン化を併用する場合でも、time-zeroの定義をプロトコル冒頭で明示することが必須です。

その他のpitfallsとして、(1) 未測定交絡因子:完全に排除はできないため、E-value(VanderWeele & Ding 2017)で頑健性を定量化し、Negative Control Outcome(Lipsitch 2010)で残存交絡を検出するのが標準的です。(2) Positivity assumption:すべての対象者がいずれの戦略にも一定確率で割り当てられうるという前提が崩れると、IPCWの重みが極端化し推定が不安定になります。重みの分布確認とtruncationが実務的対処です。(3) 多重検定・感度分析:複数の戦略比較や追跡期間の感度分析は事前にSAPで定義し、後付け解析を避けることが信頼性確保の鍵です。

10. まとめ

Target Trial Emulationは、RWDを用いた因果推論の事実上の標準フレームワークとして急速に確立しつつあります。protocolを先に書き、time-zeroを揃え、estimandと整合させる――この一連の規律は、製薬企業の生物統計家にとって今後10年の必須スキルセットです。観察研究の品質を一段引き上げ、規制当局との対話を成立させる共通言語、それがTTEの本質と言えるでしょう。

TTEは「もしRCTができたら?」を観察データで誠実に再現する設計図です。protocol事前定義・time-zero整合・IPCWによるバイアス補正の3点を押さえることで、RWDから規制グレードのエビデンスを導く道筋が見えてきます。

次回は「傾向スコア解析の実務 ― IPTW・マッチング・層別化の使い分け」を予告します。因果推論/傾向スコア/RWE シリーズとして連載していく予定です。

11. 参考文献

- Hernán MA, Robins JM. Using Big Data to Emulate a Target Trial When a Randomized Trial Is Not Available. Am J Epidemiol. 2016;183(8):758-764.

- Hernán MA, Sauer BC, Hernández-Díaz S, Platt R, Shrier I. Specifying a target trial prevents immortal time bias and other self-inflicted injuries in observational analyses. J Clin Epidemiol. 2016;79:70-75.

- Matthews AA, Danaei G, Islam N, Kurth T. Target trial emulation: applying principles of randomised trials to observational studies. BMJ. 2022;378:e071108.

- ICH E9(R1) Estimands and Sensitivity Analysis in Clinical Trials, 2019.

- VanderWeele TJ, Ding P. Sensitivity Analysis in Observational Research: Introducing the E-value. Ann Intern Med. 2017;167(4):268-274.

- Lipsitch M, Tchetgen Tchetgen E, Cohen T. Negative controls: a tool for detecting confounding and bias in observational studies. Epidemiology. 2010;21(3):383-388.

関連記事・次のステップ

- 傾向スコア分析(Propensity Score Analysis)とは ― 観察研究・リアルワールドデータにおける交絡調整の基礎とRによる実装 ―

- 逆確率重み付け(IPTW)によるATE推定 ― 傾向スコア分析の実践的応用とR・SAS実装 ―

- リアルワールドエビデンス(RWE)入門 ― 規制活用と外部対照群への展開 ―

📚 参考書籍